德州仪器深度学习(TIDL)概述

Loading the player...

将在30s后自动为您播放下一课程

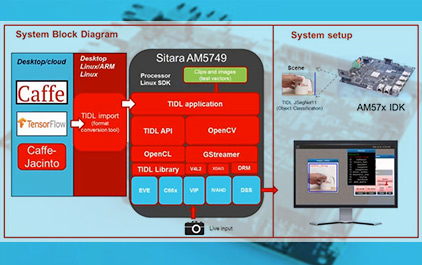

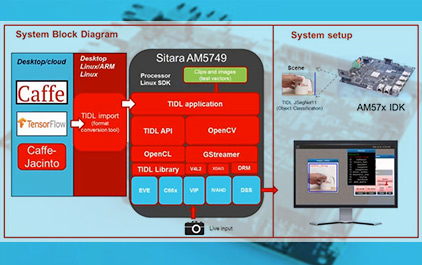

[音乐] 嗨。 在本视频中,我将讨论AM57x SoC系列 以及该系列的最新产品,名为AM5749 SoC。 AM5749处理器具有视觉处理加速器, 称为嵌入式视觉引擎子系统 或EVE子系统。 我将简要介绍EVE子系统, 它用于加速深层神经网络层。 接下来,我将讨论德州仪器 深度学习开发流程。 TI的深度学习解决方案也称为TIDL。 我将介绍AM57x SoC上的TIDL产品, TIDL支持的深度学习框架,以及在SoC上 验证的各种网络模型。 我们还将查看TIDL 可适用的示例用例。 最后,我将介绍TIDL上的TI设计。 深度学习最近成为解决人工 智能问题的首选方法。 由于可靠性,隐私, 网络带宽,延迟和功耗问题, 边缘深度学习已成为许多 应用的流行选择。 TI通过高度集成的AM57x系列 Sitara处理器,满足了为嵌入式应用 带来深度学习推理的需求。 AM57x系列配备高性能ARM Cortex-A15内核, 运行速度高达1.5千兆赫。 可扩展的AM57x系列 为加速多媒体和工业通信, 多个捕获和显示接口 以及丰富的连接外设提供专用硬件。 AM57x系列还具有单核和双核C66x处理器, 能够运行深度学习推理 以及传统的机器视觉 算法。 为了获得额外的推理性能, 该系列的最新成员AM5749处理器 还包括两个嵌入式视觉引擎子 系统。 EVE子系统是可编程的成像 和视觉处理引擎。 EVE子系统由32位RISC处理器 和512位矢量CO处理器组成。 它可以在每个周期运行16次16位MAC操作。 MAC代表乘法和累加器, 因此包括两个操作。 AM5749器件上有两个EVE内核。 每个核心的时钟频率为650兆赫兹。 在该时钟速度下,双核EVE 可以支持每秒20.8点的gig MAC, 或者每秒大约42千兆的操作。 现在您已经基本了解了AM57x SoC 深度学习处理功能, 让我们看看它如何适应深度学习开发 流程。 在高层次上,深度学习是一个两阶段的过程 - 训练和推理。 培训是开发深度学习算法的 过程。 训练完成后,将网络 部署到现场进行推理,对数据进行分类 以推断结果。 培训深度学习模型通常 使用服务器或具有外部图形处理单元 或GPU的PC上的大型数据集离线进行。 在此阶段,实时性能或功耗 不是问题。 但是,在行动期间, 实时性能和功耗可能很重要, 其中一个或两个都可以 成为许多终端产品的关键。 TIDL支持在C66x DSP和EVE子系统上 以低功耗运行 深度学习的实时推理部分。 TIDL是一套开源Linux软件包和工具, 可在AM57x SoC上部署 经过PC培训的网络模型, 以低功耗运行实时推理。 TIDL封装在处理器SDK Linux中, 可免费使用。 它可以在所有AM57x设备上运行, 因为所有AM57x处理器 都至少有一个DSP内核。 AM5749是性能最高的TIDL设备。 它有两个DSP内核和两个EVE子系统。 TIDL在EVE子系统上运行速度 提高1.5倍至4倍,与DSP内核相比功耗也更低。 两个EVE子系统在满载时 消耗220毫瓦,而双C66x核心则 消耗520毫瓦。 处理器SDK Linux 5.0中的初始TIDL 发布子部分卷积神经网络或CNN。 未来版本的处理器SDK Linux 也将支持RNN,LSTM和GRU层。 EVE子系统和DSP内核使用TIDL API进行编程。 TIDL API由在Linux上运行的C ++ API组成。 API为用户提供了一个简单的界面, 并抽象了将网络卸载到我们的 EVE子系统中的一个或多个DSP内核的机制。 它为AM57x上的一个 或多个EVE子系统和C66x内核的用户 应用程序提供了通用主机抽象。 针对CNN模型的应用, TI针对三个不同的应用领域 开发了性能优化的CNN参考模型 - 对象分类,对象检测 和像素级语义分割。 对象分类涉及预测 场景中存在的对象的类。 对象检测涉及对场景中 潜在的多个对象进行预测, 并大致了解它们的位置。 在像素级语义分割中, 区域中的不同对象具有更多细节, 以创建场景中对象的 精确轮廓。 在这种情况下,为每个像素分配一个类。 由于全帧CNN应用的计算 需求非常高,并且对于运行速度 为200至500毫瓦的典型低功耗 嵌入式内核而言无法实现, TI采用嵌入式CNN方法,如高效的CNN配置, 稀疏性和定点量化 开发示例网络模型, 可以在AM57x SoC上的一个 或多个DSP内核和EVE子系统上实时进行推理。 使用这些工具可以减少 计算和带宽,并且精度会略有下降。 例如,在EVE子系统上运行时, 稀疏性可以为稀疏卷积层 带来高达4倍的性能优化。 此幻灯片中的表列出了AM57x SoC上 支持TIDL的框架和经过验证的网络模块。 TIDL支持BVLC-Caffe,TensorFlow 和Caffe-Jacinto框架。 Caffe-Jacinto是TI的框架。 来自NVDIA-Caffe的…,而后者 又来自BVLC-Caffe。 …中的修改可以对可用于 嵌入式平台的 复杂模型进行培训。 Caffe-Jacinto框架是社区 驱动开源型,有很好的文档记录。 它托管在GitHub上。 在流行的可用模型中, TIDL已经通过SqueezeNet 1.1,InceptionNet V1 和Mobilenet 1.0进行了验证。 JacintoNet11,JDetNet和JSegNet21 是TI开发的、性能经过优化的 示例参考模型,分别用于对象分类, 检测和像素级语义 分割。 处理器SDK Linux,5.0版本, 支持2D数据上的 卷积神经网络,例如使用RGB相机 拍摄的图像或视频, 飞行时间或雷达相机等等。 客户可以在AM57x SoC上部署自己经过 CNN培训的网络模型。 或者他们可以使用TI提供的参考模型, 并在PC或云上的自定义数据集上训练模型, 并在AM57x SoC上部署他们的 列车模型以运行推理。 本幻灯片中列出了TIDL 可适用的一些示例。 例如,对象分类和检测可用于工厂自动化, 以将产品分类 为好的或有缺陷的类型。 在楼宇自动化中, 它可用于跟踪或识别和计算人员和对象。 在工业自动化中,它可用于 识别物体并引导移动或放置。 在ATM和货币柜台应用中, 它可用于区分真币 和假币。 像素级语义分割 可用于机器人导航。 对于智能家电,它可以在智能烤箱中, 以确定食物类型并自动设定 温度和烹饪程序。 它可以被智能冰箱用 来检测里面储存的食物。 我提到的应用程序 只是CNN模型的一些示例。 还有许多令人兴奋的用例 可以使用TIDL上的CNN模型解决。 在未来的版本中,TIDL将增强服务, 包括性能优化的RNN,LSTM和GRU层。 这些层将能够处理语音和音频信号, 以便进行声音检测和分类。 这可用于楼宇自动化或安全 用例。 通过识别设备的实际和预期寿命, 对RNN层的支持还将使得能够利用声音,电流, 电压信号等进行机器数据处理, 以进行预测性维护。 TIDL采用TI设计,可以引导 客户完成实施。 该TIDL参考设计演示了 如何在Sitara AM57x SoC上 使用TI深度学习解决方案,对嵌入式应用进行深入学习推理。 TIDL参考设计提供了TIDL开发流程的演练, 从网络模型设计 到模型导入, 再到AM57x SoC上模型的部署。 该设计展示了如何 在C66x DSP和所有EVE子系统上 运行深度学习推理,这些子系统在AM57x SoC上 被视为扁平盒式深度学习加速器。 它涵盖了许多流行网络模型的性能基准, 包括TI的参考模型。 此外,还报告了TI参考模型的精度 和功耗基准测试。 感谢您收看此视频。 要了解有关TI深度学习解决方案的更多信息, 请参阅此处显示的链接。 有关此培训的问题, 请访问e2e.ti.com上的TI E2E论坛。 [音乐]

[音乐] 嗨。 在本视频中,我将讨论AM57x SoC系列 以及该系列的最新产品,名为AM5749 SoC。 AM5749处理器具有视觉处理加速器, 称为嵌入式视觉引擎子系统 或EVE子系统。 我将简要介绍EVE子系统, 它用于加速深层神经网络层。 接下来,我将讨论德州仪器 深度学习开发流程。 TI的深度学习解决方案也称为TIDL。 我将介绍AM57x SoC上的TIDL产品, TIDL支持的深度学习框架,以及在SoC上 验证的各种网络模型。 我们还将查看TIDL 可适用的示例用例。 最后,我将介绍TIDL上的TI设计。 深度学习最近成为解决人工 智能问题的首选方法。 由于可靠性,隐私, 网络带宽,延迟和功耗问题, 边缘深度学习已成为许多 应用的流行选择。 TI通过高度集成的AM57x系列 Sitara处理器,满足了为嵌入式应用 带来深度学习推理的需求。 AM57x系列配备高性能ARM Cortex-A15内核, 运行速度高达1.5千兆赫。 可扩展的AM57x系列 为加速多媒体和工业通信, 多个捕获和显示接口 以及丰富的连接外设提供专用硬件。 AM57x系列还具有单核和双核C66x处理器, 能够运行深度学习推理 以及传统的机器视觉 算法。 为了获得额外的推理性能, 该系列的最新成员AM5749处理器 还包括两个嵌入式视觉引擎子 系统。 EVE子系统是可编程的成像 和视觉处理引擎。 EVE子系统由32位RISC处理器 和512位矢量CO处理器组成。 它可以在每个周期运行16次16位MAC操作。 MAC代表乘法和累加器, 因此包括两个操作。 AM5749器件上有两个EVE内核。 每个核心的时钟频率为650兆赫兹。 在该时钟速度下,双核EVE 可以支持每秒20.8点的gig MAC, 或者每秒大约42千兆的操作。 现在您已经基本了解了AM57x SoC 深度学习处理功能, 让我们看看它如何适应深度学习开发 流程。 在高层次上,深度学习是一个两阶段的过程 - 训练和推理。 培训是开发深度学习算法的 过程。 训练完成后,将网络 部署到现场进行推理,对数据进行分类 以推断结果。 培训深度学习模型通常 使用服务器或具有外部图形处理单元 或GPU的PC上的大型数据集离线进行。 在此阶段,实时性能或功耗 不是问题。 但是,在行动期间, 实时性能和功耗可能很重要, 其中一个或两个都可以 成为许多终端产品的关键。 TIDL支持在C66x DSP和EVE子系统上 以低功耗运行 深度学习的实时推理部分。 TIDL是一套开源Linux软件包和工具, 可在AM57x SoC上部署 经过PC培训的网络模型, 以低功耗运行实时推理。 TIDL封装在处理器SDK Linux中, 可免费使用。 它可以在所有AM57x设备上运行, 因为所有AM57x处理器 都至少有一个DSP内核。 AM5749是性能最高的TIDL设备。 它有两个DSP内核和两个EVE子系统。 TIDL在EVE子系统上运行速度 提高1.5倍至4倍,与DSP内核相比功耗也更低。 两个EVE子系统在满载时 消耗220毫瓦,而双C66x核心则 消耗520毫瓦。 处理器SDK Linux 5.0中的初始TIDL 发布子部分卷积神经网络或CNN。 未来版本的处理器SDK Linux 也将支持RNN,LSTM和GRU层。 EVE子系统和DSP内核使用TIDL API进行编程。 TIDL API由在Linux上运行的C ++ API组成。 API为用户提供了一个简单的界面, 并抽象了将网络卸载到我们的 EVE子系统中的一个或多个DSP内核的机制。 它为AM57x上的一个 或多个EVE子系统和C66x内核的用户 应用程序提供了通用主机抽象。 针对CNN模型的应用, TI针对三个不同的应用领域 开发了性能优化的CNN参考模型 - 对象分类,对象检测 和像素级语义分割。 对象分类涉及预测 场景中存在的对象的类。 对象检测涉及对场景中 潜在的多个对象进行预测, 并大致了解它们的位置。 在像素级语义分割中, 区域中的不同对象具有更多细节, 以创建场景中对象的 精确轮廓。 在这种情况下,为每个像素分配一个类。 由于全帧CNN应用的计算 需求非常高,并且对于运行速度 为200至500毫瓦的典型低功耗 嵌入式内核而言无法实现, TI采用嵌入式CNN方法,如高效的CNN配置, 稀疏性和定点量化 开发示例网络模型, 可以在AM57x SoC上的一个 或多个DSP内核和EVE子系统上实时进行推理。 使用这些工具可以减少 计算和带宽,并且精度会略有下降。 例如,在EVE子系统上运行时, 稀疏性可以为稀疏卷积层 带来高达4倍的性能优化。 此幻灯片中的表列出了AM57x SoC上 支持TIDL的框架和经过验证的网络模块。 TIDL支持BVLC-Caffe,TensorFlow 和Caffe-Jacinto框架。 Caffe-Jacinto是TI的框架。 来自NVDIA-Caffe的…,而后者 又来自BVLC-Caffe。 …中的修改可以对可用于 嵌入式平台的 复杂模型进行培训。 Caffe-Jacinto框架是社区 驱动开源型,有很好的文档记录。 它托管在GitHub上。 在流行的可用模型中, TIDL已经通过SqueezeNet 1.1,InceptionNet V1 和Mobilenet 1.0进行了验证。 JacintoNet11,JDetNet和JSegNet21 是TI开发的、性能经过优化的 示例参考模型,分别用于对象分类, 检测和像素级语义 分割。 处理器SDK Linux,5.0版本, 支持2D数据上的 卷积神经网络,例如使用RGB相机 拍摄的图像或视频, 飞行时间或雷达相机等等。 客户可以在AM57x SoC上部署自己经过 CNN培训的网络模型。 或者他们可以使用TI提供的参考模型, 并在PC或云上的自定义数据集上训练模型, 并在AM57x SoC上部署他们的 列车模型以运行推理。 本幻灯片中列出了TIDL 可适用的一些示例。 例如,对象分类和检测可用于工厂自动化, 以将产品分类 为好的或有缺陷的类型。 在楼宇自动化中, 它可用于跟踪或识别和计算人员和对象。 在工业自动化中,它可用于 识别物体并引导移动或放置。 在ATM和货币柜台应用中, 它可用于区分真币 和假币。 像素级语义分割 可用于机器人导航。 对于智能家电,它可以在智能烤箱中, 以确定食物类型并自动设定 温度和烹饪程序。 它可以被智能冰箱用 来检测里面储存的食物。 我提到的应用程序 只是CNN模型的一些示例。 还有许多令人兴奋的用例 可以使用TIDL上的CNN模型解决。 在未来的版本中,TIDL将增强服务, 包括性能优化的RNN,LSTM和GRU层。 这些层将能够处理语音和音频信号, 以便进行声音检测和分类。 这可用于楼宇自动化或安全 用例。 通过识别设备的实际和预期寿命, 对RNN层的支持还将使得能够利用声音,电流, 电压信号等进行机器数据处理, 以进行预测性维护。 TIDL采用TI设计,可以引导 客户完成实施。 该TIDL参考设计演示了 如何在Sitara AM57x SoC上 使用TI深度学习解决方案,对嵌入式应用进行深入学习推理。 TIDL参考设计提供了TIDL开发流程的演练, 从网络模型设计 到模型导入, 再到AM57x SoC上模型的部署。 该设计展示了如何 在C66x DSP和所有EVE子系统上 运行深度学习推理,这些子系统在AM57x SoC上 被视为扁平盒式深度学习加速器。 它涵盖了许多流行网络模型的性能基准, 包括TI的参考模型。 此外,还报告了TI参考模型的精度 和功耗基准测试。 感谢您收看此视频。 要了解有关TI深度学习解决方案的更多信息, 请参阅此处显示的链接。 有关此培训的问题, 请访问e2e.ti.com上的TI E2E论坛。 [音乐]

[音乐]

嗨。

在本视频中,我将讨论AM57x SoC系列

以及该系列的最新产品,名为AM5749 SoC。

AM5749处理器具有视觉处理加速器,

称为嵌入式视觉引擎子系统

或EVE子系统。

我将简要介绍EVE子系统,

它用于加速深层神经网络层。

接下来,我将讨论德州仪器

深度学习开发流程。

TI的深度学习解决方案也称为TIDL。

我将介绍AM57x SoC上的TIDL产品,

TIDL支持的深度学习框架,以及在SoC上

验证的各种网络模型。

我们还将查看TIDL

可适用的示例用例。

最后,我将介绍TIDL上的TI设计。

深度学习最近成为解决人工

智能问题的首选方法。

由于可靠性,隐私,

网络带宽,延迟和功耗问题,

边缘深度学习已成为许多

应用的流行选择。

TI通过高度集成的AM57x系列

Sitara处理器,满足了为嵌入式应用

带来深度学习推理的需求。

AM57x系列配备高性能ARM Cortex-A15内核,

运行速度高达1.5千兆赫。

可扩展的AM57x系列

为加速多媒体和工业通信,

多个捕获和显示接口

以及丰富的连接外设提供专用硬件。

AM57x系列还具有单核和双核C66x处理器,

能够运行深度学习推理

以及传统的机器视觉

算法。

为了获得额外的推理性能,

该系列的最新成员AM5749处理器

还包括两个嵌入式视觉引擎子

系统。

EVE子系统是可编程的成像

和视觉处理引擎。

EVE子系统由32位RISC处理器

和512位矢量CO处理器组成。

它可以在每个周期运行16次16位MAC操作。

MAC代表乘法和累加器,

因此包括两个操作。

AM5749器件上有两个EVE内核。

每个核心的时钟频率为650兆赫兹。

在该时钟速度下,双核EVE

可以支持每秒20.8点的gig MAC,

或者每秒大约42千兆的操作。

现在您已经基本了解了AM57x SoC

深度学习处理功能,

让我们看看它如何适应深度学习开发

流程。

在高层次上,深度学习是一个两阶段的过程 -

训练和推理。

培训是开发深度学习算法的

过程。

训练完成后,将网络

部署到现场进行推理,对数据进行分类

以推断结果。

培训深度学习模型通常

使用服务器或具有外部图形处理单元

或GPU的PC上的大型数据集离线进行。

在此阶段,实时性能或功耗

不是问题。

但是,在行动期间,

实时性能和功耗可能很重要,

其中一个或两个都可以

成为许多终端产品的关键。

TIDL支持在C66x DSP和EVE子系统上

以低功耗运行

深度学习的实时推理部分。

TIDL是一套开源Linux软件包和工具,

可在AM57x SoC上部署

经过PC培训的网络模型,

以低功耗运行实时推理。

TIDL封装在处理器SDK Linux中,

可免费使用。

它可以在所有AM57x设备上运行, 因为所有AM57x处理器

都至少有一个DSP内核。

AM5749是性能最高的TIDL设备。

它有两个DSP内核和两个EVE子系统。

TIDL在EVE子系统上运行速度

提高1.5倍至4倍,与DSP内核相比功耗也更低。

两个EVE子系统在满载时

消耗220毫瓦,而双C66x核心则

消耗520毫瓦。

处理器SDK Linux 5.0中的初始TIDL

发布子部分卷积神经网络或CNN。

未来版本的处理器SDK Linux

也将支持RNN,LSTM和GRU层。

EVE子系统和DSP内核使用TIDL API进行编程。

TIDL API由在Linux上运行的C ++ API组成。

API为用户提供了一个简单的界面,

并抽象了将网络卸载到我们的

EVE子系统中的一个或多个DSP内核的机制。

它为AM57x上的一个

或多个EVE子系统和C66x内核的用户

应用程序提供了通用主机抽象。

针对CNN模型的应用,

TI针对三个不同的应用领域

开发了性能优化的CNN参考模型 -

对象分类,对象检测

和像素级语义分割。

对象分类涉及预测

场景中存在的对象的类。

对象检测涉及对场景中

潜在的多个对象进行预测,

并大致了解它们的位置。

在像素级语义分割中,

区域中的不同对象具有更多细节,

以创建场景中对象的

精确轮廓。

在这种情况下,为每个像素分配一个类。

由于全帧CNN应用的计算

需求非常高,并且对于运行速度

为200至500毫瓦的典型低功耗

嵌入式内核而言无法实现,

TI采用嵌入式CNN方法,如高效的CNN配置,

稀疏性和定点量化

开发示例网络模型,

可以在AM57x SoC上的一个

或多个DSP内核和EVE子系统上实时进行推理。

使用这些工具可以减少

计算和带宽,并且精度会略有下降。

例如,在EVE子系统上运行时,

稀疏性可以为稀疏卷积层

带来高达4倍的性能优化。

此幻灯片中的表列出了AM57x SoC上

支持TIDL的框架和经过验证的网络模块。

TIDL支持BVLC-Caffe,TensorFlow

和Caffe-Jacinto框架。

Caffe-Jacinto是TI的框架。

来自NVDIA-Caffe的…,而后者

又来自BVLC-Caffe。

…中的修改可以对可用于

嵌入式平台的

复杂模型进行培训。

Caffe-Jacinto框架是社区

驱动开源型,有很好的文档记录。

它托管在GitHub上。

在流行的可用模型中,

TIDL已经通过SqueezeNet 1.1,InceptionNet V1

和Mobilenet 1.0进行了验证。

JacintoNet11,JDetNet和JSegNet21

是TI开发的、性能经过优化的

示例参考模型,分别用于对象分类,

检测和像素级语义

分割。

处理器SDK Linux,5.0版本,

支持2D数据上的

卷积神经网络,例如使用RGB相机

拍摄的图像或视频,

飞行时间或雷达相机等等。

客户可以在AM57x SoC上部署自己经过

CNN培训的网络模型。

或者他们可以使用TI提供的参考模型,

并在PC或云上的自定义数据集上训练模型,

并在AM57x SoC上部署他们的

列车模型以运行推理。

本幻灯片中列出了TIDL

可适用的一些示例。

例如,对象分类和检测可用于工厂自动化,

以将产品分类

为好的或有缺陷的类型。

在楼宇自动化中,

它可用于跟踪或识别和计算人员和对象。

在工业自动化中,它可用于

识别物体并引导移动或放置。

在ATM和货币柜台应用中,

它可用于区分真币

和假币。

像素级语义分割

可用于机器人导航。

对于智能家电,它可以在智能烤箱中,

以确定食物类型并自动设定

温度和烹饪程序。

它可以被智能冰箱用

来检测里面储存的食物。

我提到的应用程序

只是CNN模型的一些示例。

还有许多令人兴奋的用例

可以使用TIDL上的CNN模型解决。

在未来的版本中,TIDL将增强服务,

包括性能优化的RNN,LSTM和GRU层。

这些层将能够处理语音和音频信号,

以便进行声音检测和分类。

这可用于楼宇自动化或安全

用例。

通过识别设备的实际和预期寿命,

对RNN层的支持还将使得能够利用声音,电流,

电压信号等进行机器数据处理,

以进行预测性维护。

TIDL采用TI设计,可以引导

客户完成实施。

该TIDL参考设计演示了

如何在Sitara AM57x SoC上

使用TI深度学习解决方案,对嵌入式应用进行深入学习推理。

TIDL参考设计提供了TIDL开发流程的演练,

从网络模型设计

到模型导入,

再到AM57x SoC上模型的部署。

该设计展示了如何

在C66x DSP和所有EVE子系统上

运行深度学习推理,这些子系统在AM57x SoC上

被视为扁平盒式深度学习加速器。

它涵盖了许多流行网络模型的性能基准,

包括TI的参考模型。

此外,还报告了TI参考模型的精度

和功耗基准测试。

感谢您收看此视频。

要了解有关TI深度学习解决方案的更多信息,

请参阅此处显示的链接。

有关此培训的问题,

请访问e2e.ti.com上的TI E2E论坛。

[音乐]

[音乐] 嗨。 在本视频中,我将讨论AM57x SoC系列 以及该系列的最新产品,名为AM5749 SoC。 AM5749处理器具有视觉处理加速器, 称为嵌入式视觉引擎子系统 或EVE子系统。 我将简要介绍EVE子系统, 它用于加速深层神经网络层。 接下来,我将讨论德州仪器 深度学习开发流程。 TI的深度学习解决方案也称为TIDL。 我将介绍AM57x SoC上的TIDL产品, TIDL支持的深度学习框架,以及在SoC上 验证的各种网络模型。 我们还将查看TIDL 可适用的示例用例。 最后,我将介绍TIDL上的TI设计。 深度学习最近成为解决人工 智能问题的首选方法。 由于可靠性,隐私, 网络带宽,延迟和功耗问题, 边缘深度学习已成为许多 应用的流行选择。 TI通过高度集成的AM57x系列 Sitara处理器,满足了为嵌入式应用 带来深度学习推理的需求。 AM57x系列配备高性能ARM Cortex-A15内核, 运行速度高达1.5千兆赫。 可扩展的AM57x系列 为加速多媒体和工业通信, 多个捕获和显示接口 以及丰富的连接外设提供专用硬件。 AM57x系列还具有单核和双核C66x处理器, 能够运行深度学习推理 以及传统的机器视觉 算法。 为了获得额外的推理性能, 该系列的最新成员AM5749处理器 还包括两个嵌入式视觉引擎子 系统。 EVE子系统是可编程的成像 和视觉处理引擎。 EVE子系统由32位RISC处理器 和512位矢量CO处理器组成。 它可以在每个周期运行16次16位MAC操作。 MAC代表乘法和累加器, 因此包括两个操作。 AM5749器件上有两个EVE内核。 每个核心的时钟频率为650兆赫兹。 在该时钟速度下,双核EVE 可以支持每秒20.8点的gig MAC, 或者每秒大约42千兆的操作。 现在您已经基本了解了AM57x SoC 深度学习处理功能, 让我们看看它如何适应深度学习开发 流程。 在高层次上,深度学习是一个两阶段的过程 - 训练和推理。 培训是开发深度学习算法的 过程。 训练完成后,将网络 部署到现场进行推理,对数据进行分类 以推断结果。 培训深度学习模型通常 使用服务器或具有外部图形处理单元 或GPU的PC上的大型数据集离线进行。 在此阶段,实时性能或功耗 不是问题。 但是,在行动期间, 实时性能和功耗可能很重要, 其中一个或两个都可以 成为许多终端产品的关键。 TIDL支持在C66x DSP和EVE子系统上 以低功耗运行 深度学习的实时推理部分。 TIDL是一套开源Linux软件包和工具, 可在AM57x SoC上部署 经过PC培训的网络模型, 以低功耗运行实时推理。 TIDL封装在处理器SDK Linux中, 可免费使用。 它可以在所有AM57x设备上运行, 因为所有AM57x处理器 都至少有一个DSP内核。 AM5749是性能最高的TIDL设备。 它有两个DSP内核和两个EVE子系统。 TIDL在EVE子系统上运行速度 提高1.5倍至4倍,与DSP内核相比功耗也更低。 两个EVE子系统在满载时 消耗220毫瓦,而双C66x核心则 消耗520毫瓦。 处理器SDK Linux 5.0中的初始TIDL 发布子部分卷积神经网络或CNN。 未来版本的处理器SDK Linux 也将支持RNN,LSTM和GRU层。 EVE子系统和DSP内核使用TIDL API进行编程。 TIDL API由在Linux上运行的C ++ API组成。 API为用户提供了一个简单的界面, 并抽象了将网络卸载到我们的 EVE子系统中的一个或多个DSP内核的机制。 它为AM57x上的一个 或多个EVE子系统和C66x内核的用户 应用程序提供了通用主机抽象。 针对CNN模型的应用, TI针对三个不同的应用领域 开发了性能优化的CNN参考模型 - 对象分类,对象检测 和像素级语义分割。 对象分类涉及预测 场景中存在的对象的类。 对象检测涉及对场景中 潜在的多个对象进行预测, 并大致了解它们的位置。 在像素级语义分割中, 区域中的不同对象具有更多细节, 以创建场景中对象的 精确轮廓。 在这种情况下,为每个像素分配一个类。 由于全帧CNN应用的计算 需求非常高,并且对于运行速度 为200至500毫瓦的典型低功耗 嵌入式内核而言无法实现, TI采用嵌入式CNN方法,如高效的CNN配置, 稀疏性和定点量化 开发示例网络模型, 可以在AM57x SoC上的一个 或多个DSP内核和EVE子系统上实时进行推理。 使用这些工具可以减少 计算和带宽,并且精度会略有下降。 例如,在EVE子系统上运行时, 稀疏性可以为稀疏卷积层 带来高达4倍的性能优化。 此幻灯片中的表列出了AM57x SoC上 支持TIDL的框架和经过验证的网络模块。 TIDL支持BVLC-Caffe,TensorFlow 和Caffe-Jacinto框架。 Caffe-Jacinto是TI的框架。 来自NVDIA-Caffe的…,而后者 又来自BVLC-Caffe。 …中的修改可以对可用于 嵌入式平台的 复杂模型进行培训。 Caffe-Jacinto框架是社区 驱动开源型,有很好的文档记录。 它托管在GitHub上。 在流行的可用模型中, TIDL已经通过SqueezeNet 1.1,InceptionNet V1 和Mobilenet 1.0进行了验证。 JacintoNet11,JDetNet和JSegNet21 是TI开发的、性能经过优化的 示例参考模型,分别用于对象分类, 检测和像素级语义 分割。 处理器SDK Linux,5.0版本, 支持2D数据上的 卷积神经网络,例如使用RGB相机 拍摄的图像或视频, 飞行时间或雷达相机等等。 客户可以在AM57x SoC上部署自己经过 CNN培训的网络模型。 或者他们可以使用TI提供的参考模型, 并在PC或云上的自定义数据集上训练模型, 并在AM57x SoC上部署他们的 列车模型以运行推理。 本幻灯片中列出了TIDL 可适用的一些示例。 例如,对象分类和检测可用于工厂自动化, 以将产品分类 为好的或有缺陷的类型。 在楼宇自动化中, 它可用于跟踪或识别和计算人员和对象。 在工业自动化中,它可用于 识别物体并引导移动或放置。 在ATM和货币柜台应用中, 它可用于区分真币 和假币。 像素级语义分割 可用于机器人导航。 对于智能家电,它可以在智能烤箱中, 以确定食物类型并自动设定 温度和烹饪程序。 它可以被智能冰箱用 来检测里面储存的食物。 我提到的应用程序 只是CNN模型的一些示例。 还有许多令人兴奋的用例 可以使用TIDL上的CNN模型解决。 在未来的版本中,TIDL将增强服务, 包括性能优化的RNN,LSTM和GRU层。 这些层将能够处理语音和音频信号, 以便进行声音检测和分类。 这可用于楼宇自动化或安全 用例。 通过识别设备的实际和预期寿命, 对RNN层的支持还将使得能够利用声音,电流, 电压信号等进行机器数据处理, 以进行预测性维护。 TIDL采用TI设计,可以引导 客户完成实施。 该TIDL参考设计演示了 如何在Sitara AM57x SoC上 使用TI深度学习解决方案,对嵌入式应用进行深入学习推理。 TIDL参考设计提供了TIDL开发流程的演练, 从网络模型设计 到模型导入, 再到AM57x SoC上模型的部署。 该设计展示了如何 在C66x DSP和所有EVE子系统上 运行深度学习推理,这些子系统在AM57x SoC上 被视为扁平盒式深度学习加速器。 它涵盖了许多流行网络模型的性能基准, 包括TI的参考模型。 此外,还报告了TI参考模型的精度 和功耗基准测试。 感谢您收看此视频。 要了解有关TI深度学习解决方案的更多信息, 请参阅此处显示的链接。 有关此培训的问题, 请访问e2e.ti.com上的TI E2E论坛。 [音乐]

[音乐]

嗨。

在本视频中,我将讨论AM57x SoC系列

以及该系列的最新产品,名为AM5749 SoC。

AM5749处理器具有视觉处理加速器,

称为嵌入式视觉引擎子系统

或EVE子系统。

我将简要介绍EVE子系统,

它用于加速深层神经网络层。

接下来,我将讨论德州仪器

深度学习开发流程。

TI的深度学习解决方案也称为TIDL。

我将介绍AM57x SoC上的TIDL产品,

TIDL支持的深度学习框架,以及在SoC上

验证的各种网络模型。

我们还将查看TIDL

可适用的示例用例。

最后,我将介绍TIDL上的TI设计。

深度学习最近成为解决人工

智能问题的首选方法。

由于可靠性,隐私,

网络带宽,延迟和功耗问题,

边缘深度学习已成为许多

应用的流行选择。

TI通过高度集成的AM57x系列

Sitara处理器,满足了为嵌入式应用

带来深度学习推理的需求。

AM57x系列配备高性能ARM Cortex-A15内核,

运行速度高达1.5千兆赫。

可扩展的AM57x系列

为加速多媒体和工业通信,

多个捕获和显示接口

以及丰富的连接外设提供专用硬件。

AM57x系列还具有单核和双核C66x处理器,

能够运行深度学习推理

以及传统的机器视觉

算法。

为了获得额外的推理性能,

该系列的最新成员AM5749处理器

还包括两个嵌入式视觉引擎子

系统。

EVE子系统是可编程的成像

和视觉处理引擎。

EVE子系统由32位RISC处理器

和512位矢量CO处理器组成。

它可以在每个周期运行16次16位MAC操作。

MAC代表乘法和累加器,

因此包括两个操作。

AM5749器件上有两个EVE内核。

每个核心的时钟频率为650兆赫兹。

在该时钟速度下,双核EVE

可以支持每秒20.8点的gig MAC,

或者每秒大约42千兆的操作。

现在您已经基本了解了AM57x SoC

深度学习处理功能,

让我们看看它如何适应深度学习开发

流程。

在高层次上,深度学习是一个两阶段的过程 -

训练和推理。

培训是开发深度学习算法的

过程。

训练完成后,将网络

部署到现场进行推理,对数据进行分类

以推断结果。

培训深度学习模型通常

使用服务器或具有外部图形处理单元

或GPU的PC上的大型数据集离线进行。

在此阶段,实时性能或功耗

不是问题。

但是,在行动期间,

实时性能和功耗可能很重要,

其中一个或两个都可以

成为许多终端产品的关键。

TIDL支持在C66x DSP和EVE子系统上

以低功耗运行

深度学习的实时推理部分。

TIDL是一套开源Linux软件包和工具,

可在AM57x SoC上部署

经过PC培训的网络模型,

以低功耗运行实时推理。

TIDL封装在处理器SDK Linux中,

可免费使用。

它可以在所有AM57x设备上运行, 因为所有AM57x处理器

都至少有一个DSP内核。

AM5749是性能最高的TIDL设备。

它有两个DSP内核和两个EVE子系统。

TIDL在EVE子系统上运行速度

提高1.5倍至4倍,与DSP内核相比功耗也更低。

两个EVE子系统在满载时

消耗220毫瓦,而双C66x核心则

消耗520毫瓦。

处理器SDK Linux 5.0中的初始TIDL

发布子部分卷积神经网络或CNN。

未来版本的处理器SDK Linux

也将支持RNN,LSTM和GRU层。

EVE子系统和DSP内核使用TIDL API进行编程。

TIDL API由在Linux上运行的C ++ API组成。

API为用户提供了一个简单的界面,

并抽象了将网络卸载到我们的

EVE子系统中的一个或多个DSP内核的机制。

它为AM57x上的一个

或多个EVE子系统和C66x内核的用户

应用程序提供了通用主机抽象。

针对CNN模型的应用,

TI针对三个不同的应用领域

开发了性能优化的CNN参考模型 -

对象分类,对象检测

和像素级语义分割。

对象分类涉及预测

场景中存在的对象的类。

对象检测涉及对场景中

潜在的多个对象进行预测,

并大致了解它们的位置。

在像素级语义分割中,

区域中的不同对象具有更多细节,

以创建场景中对象的

精确轮廓。

在这种情况下,为每个像素分配一个类。

由于全帧CNN应用的计算

需求非常高,并且对于运行速度

为200至500毫瓦的典型低功耗

嵌入式内核而言无法实现,

TI采用嵌入式CNN方法,如高效的CNN配置,

稀疏性和定点量化

开发示例网络模型,

可以在AM57x SoC上的一个

或多个DSP内核和EVE子系统上实时进行推理。

使用这些工具可以减少

计算和带宽,并且精度会略有下降。

例如,在EVE子系统上运行时,

稀疏性可以为稀疏卷积层

带来高达4倍的性能优化。

此幻灯片中的表列出了AM57x SoC上

支持TIDL的框架和经过验证的网络模块。

TIDL支持BVLC-Caffe,TensorFlow

和Caffe-Jacinto框架。

Caffe-Jacinto是TI的框架。

来自NVDIA-Caffe的…,而后者

又来自BVLC-Caffe。

…中的修改可以对可用于

嵌入式平台的

复杂模型进行培训。

Caffe-Jacinto框架是社区

驱动开源型,有很好的文档记录。

它托管在GitHub上。

在流行的可用模型中,

TIDL已经通过SqueezeNet 1.1,InceptionNet V1

和Mobilenet 1.0进行了验证。

JacintoNet11,JDetNet和JSegNet21

是TI开发的、性能经过优化的

示例参考模型,分别用于对象分类,

检测和像素级语义

分割。

处理器SDK Linux,5.0版本,

支持2D数据上的

卷积神经网络,例如使用RGB相机

拍摄的图像或视频,

飞行时间或雷达相机等等。

客户可以在AM57x SoC上部署自己经过

CNN培训的网络模型。

或者他们可以使用TI提供的参考模型,

并在PC或云上的自定义数据集上训练模型,

并在AM57x SoC上部署他们的

列车模型以运行推理。

本幻灯片中列出了TIDL

可适用的一些示例。

例如,对象分类和检测可用于工厂自动化,

以将产品分类

为好的或有缺陷的类型。

在楼宇自动化中,

它可用于跟踪或识别和计算人员和对象。

在工业自动化中,它可用于

识别物体并引导移动或放置。

在ATM和货币柜台应用中,

它可用于区分真币

和假币。

像素级语义分割

可用于机器人导航。

对于智能家电,它可以在智能烤箱中,

以确定食物类型并自动设定

温度和烹饪程序。

它可以被智能冰箱用

来检测里面储存的食物。

我提到的应用程序

只是CNN模型的一些示例。

还有许多令人兴奋的用例

可以使用TIDL上的CNN模型解决。

在未来的版本中,TIDL将增强服务,

包括性能优化的RNN,LSTM和GRU层。

这些层将能够处理语音和音频信号,

以便进行声音检测和分类。

这可用于楼宇自动化或安全

用例。

通过识别设备的实际和预期寿命,

对RNN层的支持还将使得能够利用声音,电流,

电压信号等进行机器数据处理,

以进行预测性维护。

TIDL采用TI设计,可以引导

客户完成实施。

该TIDL参考设计演示了

如何在Sitara AM57x SoC上

使用TI深度学习解决方案,对嵌入式应用进行深入学习推理。

TIDL参考设计提供了TIDL开发流程的演练,

从网络模型设计

到模型导入,

再到AM57x SoC上模型的部署。

该设计展示了如何

在C66x DSP和所有EVE子系统上

运行深度学习推理,这些子系统在AM57x SoC上

被视为扁平盒式深度学习加速器。

它涵盖了许多流行网络模型的性能基准,

包括TI的参考模型。

此外,还报告了TI参考模型的精度

和功耗基准测试。

感谢您收看此视频。

要了解有关TI深度学习解决方案的更多信息,

请参阅此处显示的链接。

有关此培训的问题,

请访问e2e.ti.com上的TI E2E论坛。

[音乐]

手机看

扫码用手机观看

-

未学习 德州仪器深度学习(TIDL)概述

未学习 德州仪器深度学习(TIDL)概述

00:13:10

播放中

视频简介

视频简介

德州仪器深度学习(TIDL)概述

所属课程:德州仪器深度学习(TIDL)概述

发布时间:2019.08.07

视频集数:1

本节视频时长:00:13:10

本培训将介绍德州仪器深度学习(TIDL),该产品现已作为TI针对AM57x SoC处理器系列的免费处理器SDK的一部分提供,并允许在边缘运行深度学习推理。 所有AM57x处理器都可以使用C66x DSP内核加速深层神经网络层。 AM5749处理器还具有视觉处理加速器,称为嵌入式视觉引擎(EVE)子系统,可提供更多的深度学习算法加速。 您还将了解TIDL开发流程,TIDL支持的深度学习框架,在SoC上验证的各种网络模型,以及TIDL可适用的示例用例,包括TIDL参考设计。

视频简介

视频简介